本文作者:robozhang,腾讯WXG产品策划

引言

随着去年ChatGPT和AI绘画的爆火,AIGC成为了大家关注的焦点。本篇文章试图从产品经理的角度,系统地讲述下AIGC的技术和商业化现状,谈谈对未来发展前景的展望。

2012年发表的AlexNet被认为是深度学习的起源,同时伴随着CPU、GPU计算能力突飞猛进的发展,AI行业迎来了一波产业爆发。以AI四小龙为代表的一批AI公司迅猛发展,人脸识别、视频理解、语音转文字、机器翻译等一系列AI功能落地到了各行各业。

这一波AI落地的功能有一个共同的特点:任务通常具有标准答案,即对于需要AI完成的任务,我们通常都有一个预期内的标准答案。这一类任务在研发AI模型时,我们会使用大量的带标签(标准答案)的数据来训练。为了和AIGC的任务做区分,我们把这一类任务叫做“有监督任务”。

与有监督任务对应,AIGC的任务通常都是没有标准答案的,例如ChatGPT和AI绘画,我们希望AI来帮助我们生成一些内容,答案是开放式的。目前AIGC在业界的发展,其实也分为了两个方向:

以ChatGPT为代表的文生文(输入文字,模型生成文字)模型和Diffusion Model(扩散模型)技术突破带来的一系列文生图(输入文字,模型生成图片)模型。这两者目前的技术现状、商业化落地形态都不太一样,本篇文章将主要介绍文本生文领域的情况。

一、AIGC为什么火了

很多人可能会有这个问题,为什么AIGC最近又火了,ChatGPT和siri等语音助理有什么不同?要回答这个问题,首先要了解下技术的原理。

之前提到,有监督任务有一个共同点:任务通常具有标准答案。之前的AI技术只能解决需要明确结果的问题,人脸识别、视频理解、语音转文字、机器翻译等都属于这一类。对于开放式的问题,往往不能得到很好的结果。

即使是类似siri这种语音助理,看似自由的问答背后,也是通过一系列规则和提前设置好的答案范式实现的,所以往往人们的提问一旦超过了提前设置好的规则范式覆盖的范围,AI助理的回答就会让人觉得很“人工智障”。

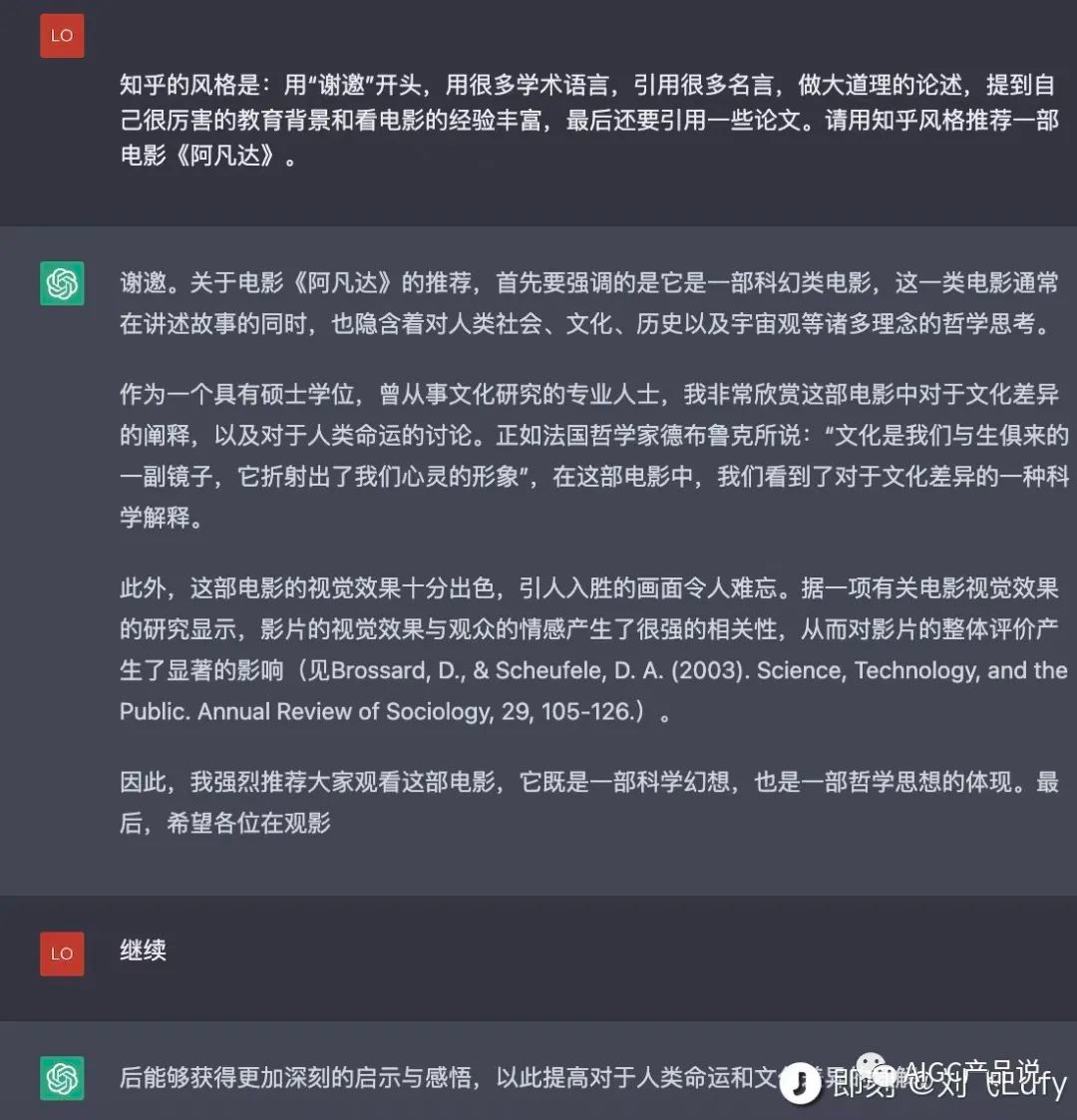

最近一批以ChatGPT为代表的文生文模型(下文改称为预训练大模型,以便和业界常用叫法对齐)则不同,这一批模型在解决开放式问题上有了飞跃式的进步。例如下面这张图:

图片来源:见水印

这张图片体现了ChatGPT强大的语言理解能力和创作能力,模型可以真正理解我们文字表达的内容,并且创作出我们希望的答案。这是以前通过规则和范式设计的AI助理不可能实现的效果。

预训练大模型如此强大的语言理解和创作能力,这是由庞大的训练数据集和模型结构带来的。作为对比,上一代AI中NLP任务的预训练模型代表BERT,训练数据集在10+GB的量级,模型参数量为3.4亿。而当前预训练大模型代表GPT-3,训练数据集规模为数十TB级,模型参数量达到了1750亿。

不管是训练数据量还是模型参数量,都达到了上千倍的差异。

举例类比的话,传统的AI模型类似单片机,结构简单、功能单一,而且每个模型设计好之后只能完成某一种固定的任务;现在的预训练大模型类似微处理器,结构更复杂、功能更强大,而且更通用,可以完成各种不同类型的任务。从单片机到微处理器,是底层技术的一个质的飞跃,甚至可能带来新一次的工业革命,因此也就不奇怪现在如此火热的关注度了。

二、商业化现状

既然预训练大模型这么厉害,目前商业化进展到哪一步了?

要回答这个问题,先要了解下预训练大模型的特点,从技术自身出发,才能推导出因此可能造就的产业形态。

技术特点

预训练大模型有两个特点:

1、多任务通用

传统不管是CV模型也好、NLP模型也好,基本都是单任务的,也就是一个模型解决一个问题,比如人脸识别、物体检测、情感识别等等,面对新的任务就要重新训练模型,甚至即使同一个任务、场景稍微不同就要重新训练,AI模型如此差的泛化能力,导致产品化非常困难。AI创业公司们只能奔波于一个又一个的项目,被人调侃称“AI外包商”。

而目前的预训练大模型则不同,以ChatGPT为例,它可以闲聊、帮忙写文章、回答问题、调试代码,单个模型就能完成多个任务。从已经验证的实际效果来看,对于大多数场景都可以不用训练、或者只需要几千或几万条数据简单finetune就能得到可以商业化落地的效果。这么优秀的泛化能力让大模型具备一个“产品”的属性,而不仅仅是针对某个具体场景的“项目”。

2、训练和推理成本高昂

之前提到,目前的预训练大模型使用了超大的训练数据集和模型参数量,这也导致了高昂的训练成本,以GPT-3为例,2020年当时训练费用就高达1200万美金。如今虽然硬件成本和训练技巧上都有优化,要支持研发ChatGPT水平的模型,根据估算至少需要数百张A100。

也就是说,光GPU的维护成本,每个月就需要上百万,这还不包括数据、人力等的成本。另外,大模型的推理成本同样高昂。OpenAI官方提到,使用ChatGPT进行一次对话的成本就高达几美分。

这两大特点,将会导致全新的产业生态体系。

产业生态

预训练大模型的商业化目前还在非常早期的阶段,没有形成体系。从实际应用的角度,目前大模型从生产到落地大致有这么几层:基础模型层,场景化模型层,应用层,用户层。

1、基础模型层

即预训练大模型层,一般为通用模型且有千亿级以上的参数量。由于预训练大模型的高成本和技术投入,因此具有较高的进入门槛。目前进入基础模型层的主要机构为头部科技企业、科研机构等。

2、场景化模型层

指的是针对具体业务场景定制化的模型,这一层模型以能实际解决业务问题为准,对参数量不做限制,十亿到千亿参数量都有可能。

这一层的公司有两类:一类是基础模型层公司本身,可能会通过各种方式(提供finetune接口、针对客户定制服务等)生产这一层的模型;另一类是一些中小规模创业公司,可能直接提供这一层的模型服务给客户。

3、应用层

基于场景化模型开发的能实际解决业务问题的应用,例如jasper.ai等。这也是现在讨论最热的部分,写作辅助、情感聊天、搜索引擎插件、辅助编程等等,各种应用领域在不断的被探索。

4、用户层

使用AIGC应用的用户。

采用传统云服务领域的术语的话,基础层+场景化服务层类似于云服务领域的PaaS层,应用层类似于云服务领域的SaaS层。从实际的商业化落地来看,目前很多公司都会有跨越多个层级的情况,还没有形成一个稳定的产业生态。从作者了解到的信息来看,目前大模型的落地有这么几种产业生态。

1、自研大模型赋能自身业务

这类公司横跨基础模型层、场景化模型层、应用层三个层级,一般为头部科技企业。典型代表是微软。微软作为OpenAI的投资方,已经宣布会在全线产品接入ChatGPT。此外,谷歌最近也开始在这方面发力,基于自研的LaMDA大模型,计划今年推出20种新的人工智能产品。

2、自研大模型提供PaaS类服务

这类公司横跨基础模型层、场景化模型层。国外代表是OpenAI的GPT-3和ChatGPT,国内有百度文心大模型、智源悟道的悟道大模型、浪潮的源1.0、华为的盘古大模型、阿里的M6大模型等。这类公司一般通过两种形式提供场景化模型层服务:对外提供finetune接口,或者针对客户场景定制模型。

该生态下,在应用层和用户层方面,国内外又有所不同:国外目前已经涌现出了一批比较成功的处于应用层的公司(典型代表jasper.ai和copy.ai),验证了这种产业生态体系的可行性,国内目前还没有典型的应用层的公司出现,已有的主要落地形式是行业内用户基于自身需求开发应用为自己服务,即用户横跨应用层和用户层。

3、自研大模型作为基础模型层

这类公司主要是科研机构背景的公司,通过开源模型或者为第三方提供模型文件的方式提供服务。第三方公司要么直接是业务方(横跨场景化模型层、应用层、用户层),要么是互联网公司(横跨场景化模型层、应用层)使用AIGC技术服务自己的用户。

4、直接自研场景化模型

这类公司一般是一些在ChatGPT火起来之前就存在的创业公司,用中等模型(十亿到百亿参数)提供细分行业的解决方案,跳过基础模型层,服务的形式一般有只提供模型服务和直接提供应用层服务两种,看具体客户需求。典型的有澜舟科技、聆心智能、彩云科技等等。

由于用大模型蒸馏出的中等模型在推理成本相同的情况下,效果通常优于直接训练出的中等模型,因此在大模型研发火热的大背景下,这一类业务形态可能会收到冲击。

从商业化现状可以看出来,ChatGPT效果虽然惊艳,但是至少在中文领域,AIGC技术要真的深入改造各行各业还存在着很大的困难,目前存在的几种产业生态不论哪种都会有很大的阻碍:

- 纯靠大公司自研只能赋能自身业务,难以覆盖各行各业;

- 提供PaaS服务要做好完善的平台业务还有很长的路要走;

- 纯粹研究基础模型难以商业化形成闭环;

- 直接自研场景化模型又面临着效果上的不足。

三、未来展望

即使现在商业化还面临着很多困难需要解决,但是AIGC改造各行各业的未来是可以预见的。作者简单列举了两个看好的领域,抛砖引玉,希望可以和各行各业的大佬们一起探讨AIGC落地的可能性。

小说行业。预训练大模型在小说行业可以有很多应用,最典型的是辅助写小说,此外在创作IP衍生品领域,还可以根据小说改写剧本,或者和其他AIGC技术结合创作漫画等。小说行业有这么几个特点:

-

大B格局,阅文一家的收入就占了整个在线阅读领域的大约一半。大B格局的好处是用户聚集、数据资源丰富、反馈迭代快,大B客户完全可以根据自身需求,和大模型研发机构合作快速迭代适合自己平台创作者的辅助创作产品。

-

市场大且成熟。以2021年为例,整个在线阅读市场总收入规模在百亿以上,IP衍生品的市场更大,且已经形成了成熟的产业链。AIGC技术一旦验证有效,将快速产生经济价值。

目前小说行业的产品形态一般是续写、改写、润色、物品描述生成等等,但是目前还没有看到有很大量的作者使用和反馈。当前落地的难点仍然在于找到技术和业务场景的结合点。怎样在目前的作者创作流程中加入AI辅助的功能,使其能够切实提升作者创作效率,这个是需要持续探讨的问题。

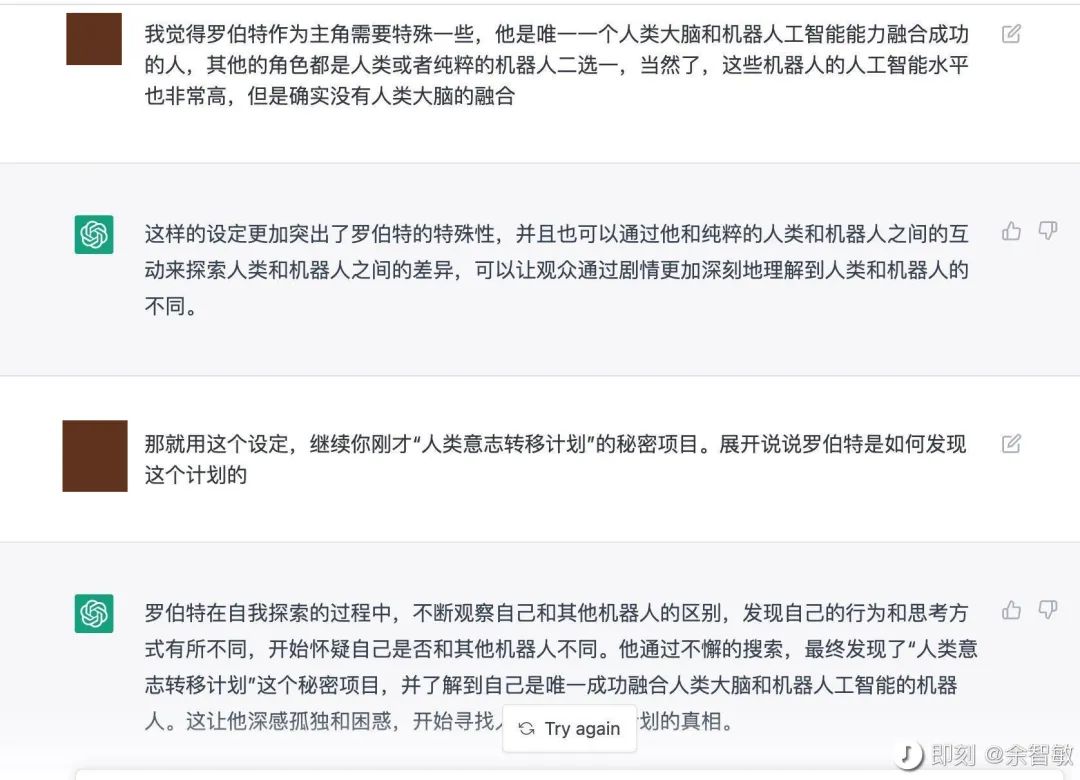

图片来源:见水印

广告营销行业。广告营销行业是我个人感觉预训练大模型最容易落地的一个行业,在国外jasper.ai、copy.ai也验证了这一行业能走得通。之所以目前国内还没有出现类似jasper.ai的公司,核心是国内和国外营销的模式不同,总结下来一共是这几点原因:

-

jasper.ai在国外三大使用场景主要是google/facebook上发广告文案、写营销博客和写邮件。这三大场景,2和3在国内都不存在,对于广告文案,国外会需要大量营销文案做精细化运营,根据文案效果调整,国内目前产品的文案一般比较固定,一旦确定更新频率很低。

-

国内创作频率高的场景主要是知乎内容、小红书种草文、新闻媒体软广等,这些内容一般形式多变,很难完全依赖AI来生成。需要探索模式相对固定的创作场景以落地实际产品。

-

中文模型生成效果的落后也是原因之一。

因此,解决这些问题可能是加速大模型在广告营销行业落地的核心。

除此之外,预训练大模型在搜索引擎插件、辅助编程等应用上,也已经验证了其巨大的潜力。在搜索引擎插件上,粗略估算大概有10%~30%的搜索问题是可以由AI来回答的,至少5%到10%的问题AI可以给出比现有搜索引擎更好的答案,考虑到搜索引擎本身巨大的市场,这会是一个非常大的提升。辅助编程上,多位实际使用者反馈copilot非常好用,对编程效率能提高20%到50%,证明了这个领域巨大的潜力。

总之,在文生文领域,虽然目前的商业化落地尚不成熟,存在着多种多样的困难。但是ChatGPT实际的使用效果验证,这一新技术跟之前相比有突破性的进步,这一进步最终一定会深刻改造各行各业,早一步加入这个浪潮,我们就有可能在这个领域里占得先机~

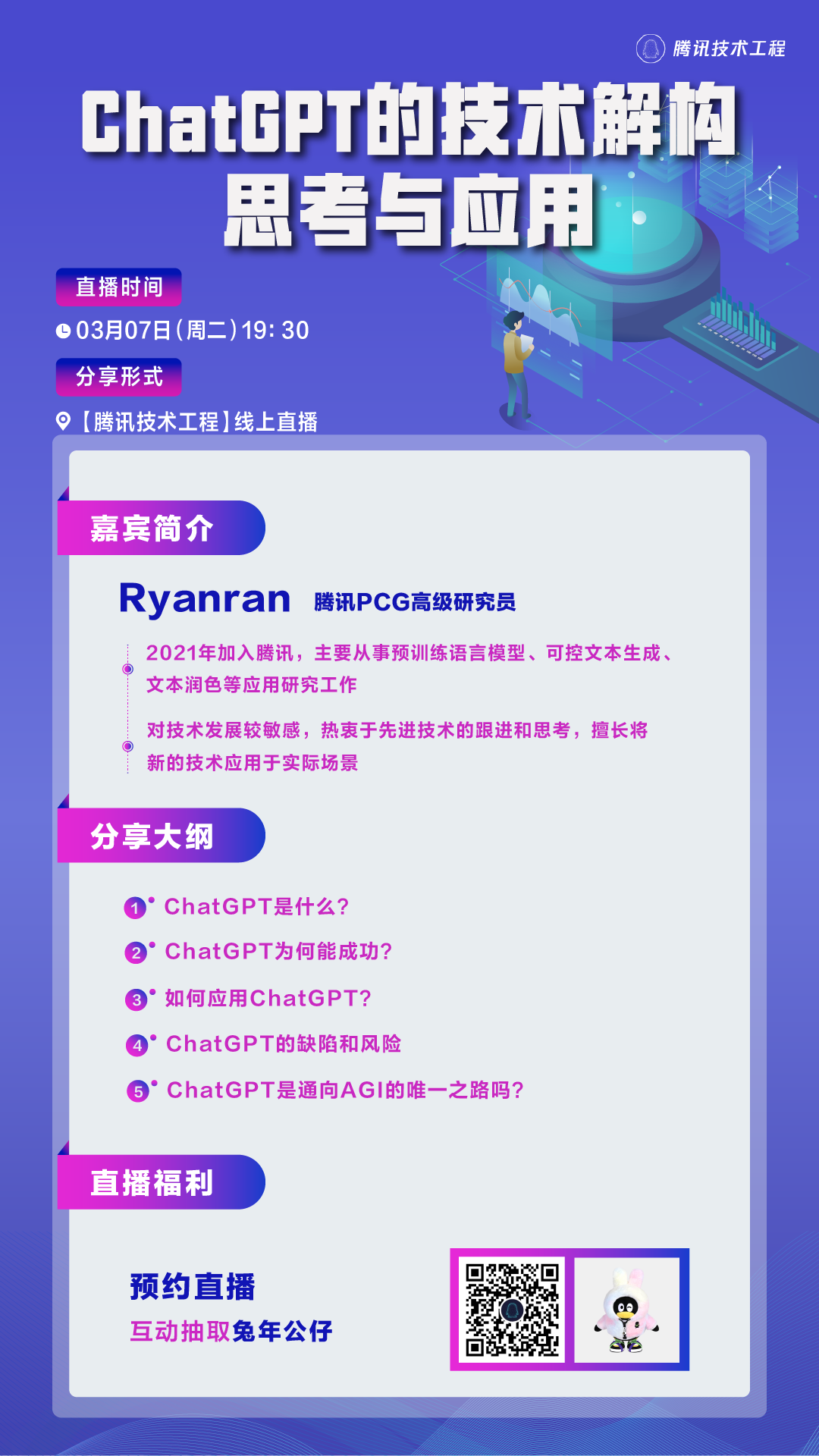

# 腾讯技术直播 #

腾讯工程师分享技术干货:

扫码预约,get开播提醒

扫码预约,get开播提醒

往期回顾: